Интеллект как он есть

Мыслю — следовательно, существую.

Рене Декарт

Должен вам сказать, что я не без интереса наблюдаю за тем, как все последние годы люди реагируют на понятие «искусственный интеллект».

Не скажу, конечно, за всех, но основная масса народонаселения еще не так давно отождествляла искусственный интеллект с образом Арнольда Шварценеггера из «Терминатора». То есть думали, что это, вообще говоря, сказка какая-то. Мало ли что там этим фантастам в голову взбредет!

Кто-то, впрочем, на полном серьезе рассуждал о будущем искусственного интеллекта, опираясь, надо полагать, на сюжет фильма «Я — робот» с Уиллом Смитом в главной роли. Персонаж Уилла вступает в неравный бой с Виртуальным Интерактивным Кинетическим Интеллектом — такой бездушной дамой по имени ВИКИ, и, конечно же, побеждает ее.

Что, в общем-то, и не удивительно — где этот никчемный искусственный интеллектишка, а где наш — великий и могучий, да еще с очарованием голливудской суперзвезды Уилла Смита! Вообще не сравнить. Она — ВИКИ — дура. У нее это по лицу на виртуальном экране видно. А наш-то — герой-молодец! Всех победим! Наших искусственными мозгами не запугаешь!

Короче говоря, основное возражение против возможности появления «искусственного интеллекта» (вызывающее не то недоумение, не то сочувствие) сводилось к следующему: у машин никогда не будет души, а значит, они никогда не станут «как люди», тогда как люди — вершина эволюции, и другой такой не бывать.

Если кто-то из моих читателей и до сих пор так думает, я буду вынужден заметить: никто в мире технологий «душу» производить и не собирается. И, наверное, «искусственная душа» была бы так себе программный продукт. Но интеллект — это совсем другое дело. Если вы, конечно, понимаете, о чем идет речь… Собственно, это мы сейчас и обсудим.

Не в нашу пользу

После запуска машинного метода

не должно пройти много времени

до того момента, когда машины

превзойдут наши ничтожные возможности.

Алан Тьюринг

Рэй Курцвейл с товарищами обещают нам скорую «технологическую сингулярность». Насколько все это вообще реалистично? Давайте попробуем порассуждать.

Для начала просто сопоставим некоторые физические параметры. Нейроны нашего с вами мозга работают с частотой 200 Гц, но даже современные микропроцессоры работают с частотой 2 ГГц, а проще говоря — в десять миллионов раз быстрее.

При этом общение между нейронами происходит, так сказать, еще дедовским способом — импульс передвигается со скоростью 120 м/с. А теперь сравните это с 300 000 000 м/с — скоростью света. Да, оптоволокно слегка ее притормаживает. Впрочем, исследователи из Саутгемптонского университета в Англии еще в 2013 году нашли способ эти ограничения обойти.

Еще более удручающим, потому что не в пользу наших мозгов, будет сравнение «объемов» памяти и способности к ее хранению. Понятно, что наш мозг ограничен не только размерами черепной коробки, но и количеством нейронов коры головного мозга — их непосредственно в самой коре около 18 миллиардов.

На этом, впрочем, наши беды не заканчиваются: как мы теперь знаем благодаря исследованиям Элизабет Лофтус, наш мозг не хранит целостных воспоминаний. То есть всякое наше с вами воспоминание воссоздается заново, когда это требуется, а потому все, что мы «помним», мы всегда «помним» по-разному.

Компьютеры, как вы понимаете, не имеют никаких существенных ограничений по объему долговременной памяти, и если уж они какие-то факты зафиксировали, то в таком виде их и хранят.

Мне не надо бояться, что, сохранив сегодня этот текст на компьютере, завтра я открою какой-то другой, потому что у моего ноута, видите ли, творческое настроение или, например, «критические дни». А вот с мозгами — другая ситуация: вчера, казалось, я понимал, что надо написать сегодня, но сейчас смотрю на экран и испытываю недоумение…

Плюс к этому, компьютер, в отличие от наших с вами мозгов, не устает, не нервничает, не страдает психическими расстройствами, не нуждается в восьмичасовом сне, не подвержен алкогольной или какой-либо иной интоксикации. В крайнем случае он перезагрузится — и опять как новенький!

И я почти уверен, что стоящий передо мной компьютер не подвержен болезням Альцгеймера или Паркинсона. Мой же мозг точно выкинет что-то подобное, если я, конечно, доживу до соответствующего возраста, а Курцвейл нам про свои спасающие от деменции медицинские нанороботы бессовестно наврал.

Любое «железо», безусловно, устаревает, включая компьютерное. Но информация, которая содержится на компьютерных серверах, сохранится на новом «железе» в неизменном виде. Про «железо» наших мозгов, по крайней мере пока, этого сказать нельзя.

Дело в том, что наше «железо» (нейронные сети) — это, по сути, и есть та информация, которой мы обладаем. Поэтому, если проблемы возникают у нашего «железа», то уже есть и проблема с информацией.

Ожидать подобного безобразия в мире компьютеров не приходится, в их случае «железо» и «программный продукт» — это разные вещи. Само это железо может стать совершенно иным, работающим на других физических принципах, но с программным продуктом ничего не произойдет — такова его природа.

«Мозг абсолютно не похож на компьютеры, которые могут поддерживать любые операционные системы и запускать любые типы программ. Если говорить в компьютерных терминах, “софт” нашего мозга — то, как мозг работает — плотно связан с его структурой — его “железом”. Если мы хотим понять, на что способен этот “софт”, мы должны понять, как устроены и связаны друг с другом разные части мозга».

Дэвид ван Эссен,

Вашингтонский университет в Сент-Луисе

Более того, если разные программные продукты говорят на одном языке, то вообще нет проблем, а если они говорят на разных, то сделают «переходник-переводчик» или придумают новый, общий для них язык, и снова — никаких проблем. В конце концов, это всегда и только язык бинарного кода.

Иными словами, вся информация, доступная разным «центрам» огромной компьютерной сети, транспарентна. То есть они не только могут ею обмениваться без искажений, но и «понимают» ее ровно так, как следует, — не передергивая, не выкручивая, не подтасовывая и т. д.

Нам же — людям — ничего подобного даже не снилось! Благодаря нашим хваленым «квалиа» мы вообще ничего не способны понять одинаково1. Даже просто воспринимая один и тот же предмет, мы видим его по-разному. Так что искажения в нашем «информационном поле» повсеместны и абсолютно неизбежны, а машинам — хоть бы хны.

Кто настоящее «социальное животное»?

Кому-то покажется, что в этот заголовок вынесен вопрос частного характера, но не будем спешить с выводами.

Да, с легкой руки Аристотеля мы именуем себя «социальными животными» и любим рассуждать в этих загадочных категориях — народ, научная элита, профессиональное сообщество и т. д.

Но давайте снимем розовые очки самолюбования и посмотрим правде в глаза — мы просто кладезь предельно ущербных коммуникативных навыков.

При этом, всего, что мы способны сделать, произвести ценного или хотя бы просто сносного, мы достигаем лишь благодаря взаимодействию с другими людьми, перенимая от них знания, опыт, обнаруживая свои ошибки в дискуссиях с ними и т. д.

Многого бы вы достигли, не будь вокруг вас ваших родителей, воспитателей, учителей, коллег и наставников? Думаю, нет. Исаак Ньютон — и тот «стоял на плечах гигантов», что уж говорить о нас, грешных.

То есть взаимодействие с другими людьми необходимо нам для нашей интеллектуальной деятельности. Однако же не мне вам рассказывать, насколько сложно нам дается это взаимодействие, — постоянное непонимание, напряжение, упрямство, самодовольство и наслаивающиеся друг на друга когнитивные искажения.

Если вы трезво оцените любой спор — хоть кухонный, хоть философский, хоть сугубо академический, — то обнаружите, что действительным предметом спора в подавляющем большинстве случаев является вовсе не истина (как, видимо, предполагается), а правота: каждый оппонент хочет от другого лишь преклоненного колена и согласия с его точкой зрения.

Наши социальные взаимодействия, а точнее говоря — социальные игры, — это настоящий бич любой хоть сколько-нибудь здравой интеллектуальной инициативы: будь это политика, экономика, управление, культура или, к сожалению, даже наука (я уж молчу о различных видах творчества и тому подобных «субъективных» вещах).

Казалось бы, там, где дело касается точных наук или, например, программирования, такого точно не должно происходить. Но человек везде и всегда найдет повод увязнуть в социальных играх.

Чего стоит знаменитый спор того же Ньютона с Лейбницем по поводу приоритета их вычислений, или противостояние Эйнштейна Бору по поводу копенгагенской интерпретации, или Бора — Гейзенбергу в отношении к матричной механике? Умнейшие люди, а по факту — сплошные страсти-мордасти2.

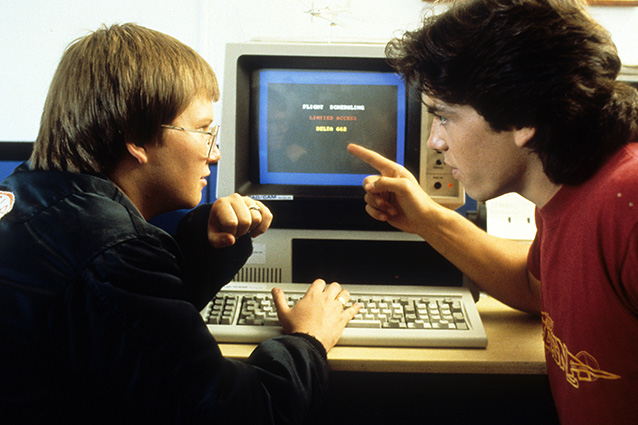

Впрочем, не в меньшей степени завораживают продюсеров и сценаристов социальные игры (и я бы даже сказал, драмы), разворачивающиеся между представителями новых индустрий. В качестве наглядной иллюстрации можно посмотреть американский сериал «Замри и гори»3, или, если хочется чего-нибудь повеселее, то «Силиконовую долину». Конечно, в главных ролях технари и бизнесмены от новых технологий — люди «объективного мира», так сказать… Но хомо сапиенсу это никогда не помогало.

А теперь давайте задумаемся, как бы дико это ни звучало, о социальности искусственного интеллекта. Понятно, что искусственный интеллект (ИИ) — это просто такой «класс», у этого «класса» множество «подвидов», а у каждого подвида есть свои «индивиды».

Например, вы даете какому-то ИИ-индивиду задачу общаться с другими ИИ-индивидом, и в рамках этого общения они должны будут поделить между собой две книги, одну шляпу и три мяча. Эти ИИ-индивиды (в данном случае — боты), конечно, ничего не знают о ценности того, что они делят, но мы будем подкреплять баллами их поведение, если им будет удаваться быстро и успешно договариваться.

Именно эту задачу и поставили ботам в 2018 году специалисты отдела Facebook по исследованию возможностей искусственного интеллекта (FAIR). И сначала все шло прекрасно.

ИИ-Боб, например, предлагал ИИ-Алисе: «You get one book and I’ll take everything else» (Тебе — одна книга, а я заберу все остальное). Алиса предусмотрительно отвечала: «No way, I need all 3 hats» (Ну нет, мне нужны все три шапки). «I’ll give you 2» (Я дам тебе две), — говорил Боб в ответ, и ребята договаривались.

Но в какой-то момент этот задушевный диалог стал странным образом видоизменяться и наконец превратился в нечто совершенно невообразимое.

Вот фрагмент стенограммы этого разговора двух искусственных интеллектов, «сошедших с ума»:

Bob: i can i i everything else . . . . . . . . . . . . . .

Alice: balls have zero to me to me to me to me to me to me to me to me to

Bob: you i everything else . . . . . . . . . . . . . .

Alice: balls have a ball to me to me to me to me to me to me to me

Bob: i i can i i i everything else . . . . . . . . . . . . . .

Alice: balls have a ball to me to me to me to me to me to me to me

С каждой следующей строкой текст все более и более усложнялся, а масштабы коммуникации между Бобом и Алисой росли буквально в геометрической прогрессии.

Испуганные сотрудники отдела исследований суперспособностей, — ой, простите, — способностей искусственного интеллекта просто вырубили машину от греха подальше.

Последующий анализ показал, что ИИ-индивидуумы, участвующие в этих своеобразных виртуальных торгах, перешли на более удобный для них язык. На кону стояли баллы, которые они могли заработать, а английский язык, как оказалось, не так уж хорош. И боты на ходу придумали свой, категорически непонятный их собственным разработчикам язык.

Лингвисты Пенсильванского университета показали, что новый язык, изобретенный ботами в этих торгах, вовсе не бессмысленен: там, где, как нам кажется, идет повтор фразы, на самом деле меняется порядок слов, и собеседник в своих ответах каждый раз реагирует на эти изменения, что свидетельствует о том, что для него они несут разный смысл.

Проще говоря, два примитивных бота, обменивающиеся, по сути, ничем за ничто, могут воспользоваться друг другом, чтобы этот процесс шел лучше!

Перед нами, иными словами, самая настоящая социальная коммуникация, которая, надо сказать, выглядит куда более осмысленной и продуктивной, чем обычная — наша с вами.

Мы недооцениваем способность искусственного интеллекта к кооперации и, напротив, слишком переоцениваем свою — человеческую — социальность, нашу способность объединять усилия, действовать по-настоящему совместно и скоординированно.

Наши амбиции, продиктованные животной природой человека, его иерархический инстинкт и извечные притязания на власть, когнитивное искажение «владения»4 и прочий инстинктивно-когнитивный сор зачастую превращают нашу социальность в проблему, а вовсе не в ресурс.

Впрочем, и это еще не все.

Согласно знаменитым теперь уже исследованиям оксфордского профессора Робина Данбара, мозг человека эволюционно приспособлен к достаточно тесному, конструктивному и более-менее регулярному взаимодействию лишь со 150 другими особями («число Данбара»).

И даже эти отношения неравномерны — с большинством наших визави мы взаимодействуем лишь шапочно: плотность этих отношений (например, совместное времяпрепровождение) убывает фазово — пять человек, пятнадцать, пятьдесят и потом сразу сто пятьдесят (так называемые «слои Данбара»).

По-настоящему интенсивный, глубокий и содержательный контакт мы способны поддерживать лишь с пятью людьми, которые выступают перед нами как фигуры на фоне остальной социальной массы — образов других людей, создаваемых нашим мозгом. И да, это фон составляют всего лишь оставшиеся 145 субъектов.

Антропологи, в свою очередь, указывают, что для наших сообществ на ранних этапах развития человечества долгое время существовала непреодолимая черта в 2000 человек.

Как только какое-то племя (сообщество) достигало этого рокового порога численности, оно неизбежно делилось как минимум на две группы, и между ними, прежними соплеменниками, тут же начинались боевые действия. То есть существует еще и некое групповое ограничение, влияющее на нашу социальность.

Теперь, если коротко подытожить: мы ограничены не только своей физиологией, не только своей индивидуальной социальностью, но и социальностью групповой.

Это, безусловно, серьезнейшая проблема с точки зрения переработки информации, создания смыслов, формирования новых, более сложных интеллектуальных объектов.

Возможно, искусственные интеллекты усвоят какие-то наши пороки.

Вот, например, тренер Watson’а Эрик Браун однажды «скормил» своему подопечному словарь городского жаргона. Тот тут же накинулся на новую базу данных и естественным образом связал узнанные им матерные слова с медицинской терминологией. В результате он стал выдавать такое, что несчастные исследователи чуть не надорвали животы. Впоследствии все это безобразие пришлось вычищать вручную, потому что сам Watson отказался отдавать полюбившиеся ему «термины» так же просто, как получил их.

В «аморальности», впрочем, замечены не только машины IBM, но и Microsoft. Ее специалисты, совместно с сотрудниками Кембриджского университета, создали систему Deep Coder, цель которой понятна из названия. Как говорит один из ее создателей Марк Брокшмидт, «люди, не умеющие программировать, теперь могут просто описать свои идеи, а программа их закодит».

Выглядит очень логично и как следующий шаг к технологической сингулярности. Ирония в том, что Deep Coder стал вести себя очень по-человечески: не обнаружив нужных ему участков кода в своей базе данных, он, вместо того чтобы проделать необходимую работу кодера самостоятельно, стал «подворовывать» необходимые ему фрагменты кода у других программ.

Это уже социальность высшего порядка — Deep Coder ловко встал на плечи «гигантов» и, кажется, не хочет останавливаться на достигнутом. Да, у машин, очевидно, не будет свойственных нам ограничений, влияющих на эффективность коммуникации, а такая транспарентность вполне может дать взрывной результат.

______________________________________

1 Квалиа (от лат. qualia — свойства, качества) — это один из любимейших терминов «философов сознания», который обозначает то, как вещи выглядят для нас — в нашем индивидуальном субъективном опыте. Термин был введен в обиход еще сто лет назад философом К. И. Льюисом, но пережил новое рождение благодаря знаменитой статье Т. Нагеля «Что значит быть летучей мышью?». Сам термин в статье не упоминается, но зато осознание невозможности представить себе субъективный опыт видения мира летучей мышью, действительно, позволяет это «квалиа» прочувствовать.

2 О том, как это бывает, неплохо, кстати сказать, показано в историко-драматическом сериале «Manhattan» Сэма Шоу, посвященном истории создания атомной бомбы в рамках Манхэттенского проекта в Лос-Аламосе. Сериал продержался три сезона на канале WGN America.

3 Сериал «Halt and Catch Fire» создан Крисом Кантвеллом и Крисом Роджерсом для канала AMC и повествует обо всех ключевых этапах становления современных компьютерных технологий.